¿Por qué falla tu n8n? Entendiende la infraestructura para escalar sin errores.

Si estás en el mundo de la inteligencia artificial y la automatización de procesos, seguro que ya conoces n8n. Es una herramienta increíble, pero hay un problema que escucho constantemente en la comunidad: "En mi computadora funciona perfecto, pero cuando lo instalo para un cliente, n8n no carga o se vuelve inestable".

La respuesta no es magia, es arquitectura. Para que tus automatizaciones dejen de fallar en producción, primero debes entender cómo "piensa" y cómo se organiza n8n internamente. En este artículo, vamos a desglosar sus tres pilares y luego lo pondremos a prueba en un servidor real para ver hasta dónde aguanta.

Los tres pilares de n8n: ¿Cómo se reparte el trabajo?

Imagina que n8n es un restaurante. Para que los platos salgan a tiempo y el local no sea un caos, se necesitan tres áreas trabajando en equipo:

1. n8n Main: La Cara Visible

Este es el servicio principal (que suele correr por el puerto 5678). Es la interfaz que ves en tu navegador: donde arrastras los nodos, haces clic en los botones y configuras tus flujos. Siguiendo nuestra analogía, el Main es el salón del restaurante; es lo que el cliente ve y donde se toman los pedidos, pero no es donde se cocina la comida.

2. La Cola de Procesos: La Comandera

¿Qué pasa cuando llegan 50 pedidos a la vez? No pueden entrar todos a la cocina al mismo tiempo. Aquí entra la cola de procesos (muchas veces gestionada por herramientas como Redis). Su función es organizar los pedidos en una fila india o sistema FIFO (First In, First Out): el primero que llega es el primero que se atiende. Ella decide quién espera y quién pasa a la siguiente etapa.

3. Los Workers: La Cocina

Aquí es donde ocurre la magia (y el esfuerzo). Los Workers son los encargados de ejecutar las tareas pesadas: analizar una imagen con IA, hacer una petición HTTP o escribir en una base de datos. Si tienes muchos pedidos pero solo una cocinera (un Worker), el servicio será lento. Si tienes muchos Workers pero poca memoria, la cocina colapsará.

Laboratorio de Pruebas: Exprimiendo un VPS

Para entender esto en la práctica, decidí poner a prueba un VPS (Servidor Virtual Privado) de HostGator. Este tipo de servidores son ideales porque ofrecen recursos dedicados y un precio fijo mensual, lo que te da tranquilidad financiera frente a los modelos de pago por ejecución.

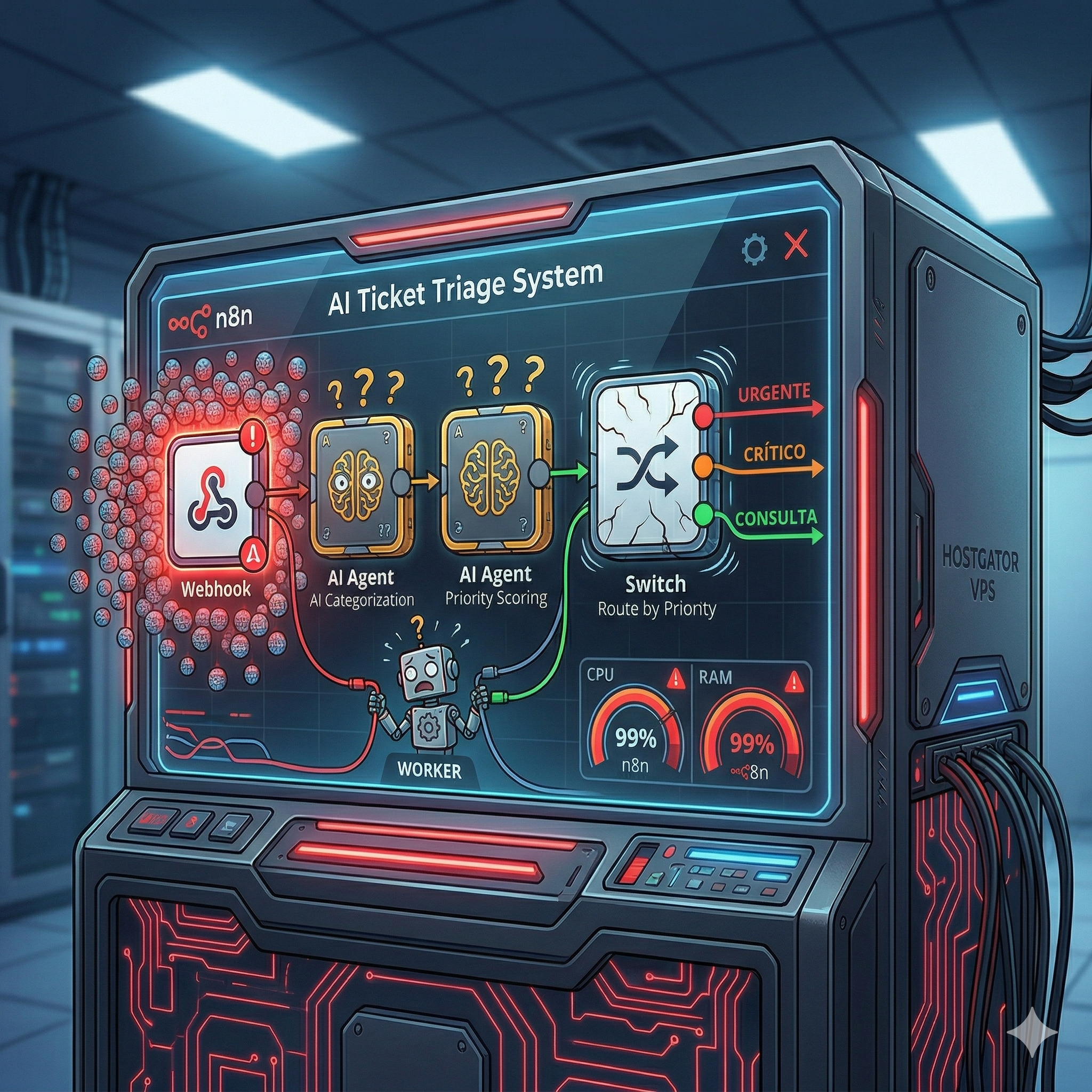

El Escenario de Prueba

Configuré un flujo de trabajo que no es excesivamente complejo, pero sí representativo:

- Un Webhook que recibe información externa.

- Una cadena de Agentes de IA que categorizan tickets de soporte.

- Conexiones a modelos de lenguaje externos.

Para monitorear qué sucede "bajo el capó" mientras el servidor trabaja, utilizo una herramienta llamada htop. Imagínalo como un panel de control que me muestra en tiempo real cuánta energía están consumiendo el procesador (CPU) y la memoria RAM.

Pruebas de Estrés: ¿Cuándo se rompe el sistema?

No basta con que un flujo funcione una vez; lo importante es saber cuántas veces puede funcionar al mismo tiempo.

1. El impacto inicial (100 peticiones)

Simulamos una ráfaga de 100 peticiones rápidas, como si una campaña publicitaria enviara tráfico de golpe.

- Resultado: El servidor (de 2 vCPU) mostró un pequeño pico de actividad, pero se recuperó rápido. La "fila" se movió con agilidad.

2. Prueba de resistencia (120 segundos constantes)

Aquí forzamos al sistema a recibir datos sin parar durante dos minutos.

- Lo que notamos: Al observar el monitor de recursos, el procesador empezó a trabajar al máximo. En la interfaz visual, notamos que n8n ya no cargaba tan rápido. Esto sucede porque el "cerebro" (Main) tiene que compartir los recursos con los "cocineros" (Workers).

3. El límite absoluto (Alta concurrencia)

Subimos la apuesta a 200 peticiones simultáneas.

- El colapso: El consumo de memoria RAM llegó a su límite de seguridad y el CPU se saturó. En este punto, la pantalla se queda en blanco. El servidor intenta protegerse reservando un poco de memoria para no "morir" del todo y poder reiniciarse, pero el servicio de n8n deja de responder.

Conclusión: La clave es el equilibrio

Por defecto, n8n viene configurado para manejar 10 ejecuciones paralelas. Si intentas procesar 50 cosas a la vez en un servidor pequeño, se va a colgar.

La clave para que tus automatizaciones sean estables en el mundo real es dimensionar correctamente tu servidor según el volumen de datos que esperas recibir. No escatimes en recursos si planeas manejar procesos críticos o flujos con mucha concurrencia.

Gracias por leer Código en Casa, ¿Te gustaría que hiciéramos más pruebas comparando diferentes potencias de servidores? ¡Cuéntamelo en los comentarios y si quieres ver como se hace te dejo el video aqui 👇!